Как преобразовать a.wav-файл на спектрограмму в python3

Я пытаюсь создать спектрограмму из a .wav файл в python3.

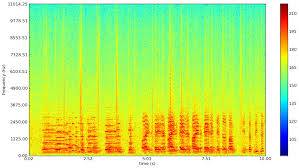

Я хочу, чтобы окончательное сохраненное изображение выглядело похожим на это изображение:

я попробовал следующее:

это переполнение стека пост: спектрограмму звукового файла

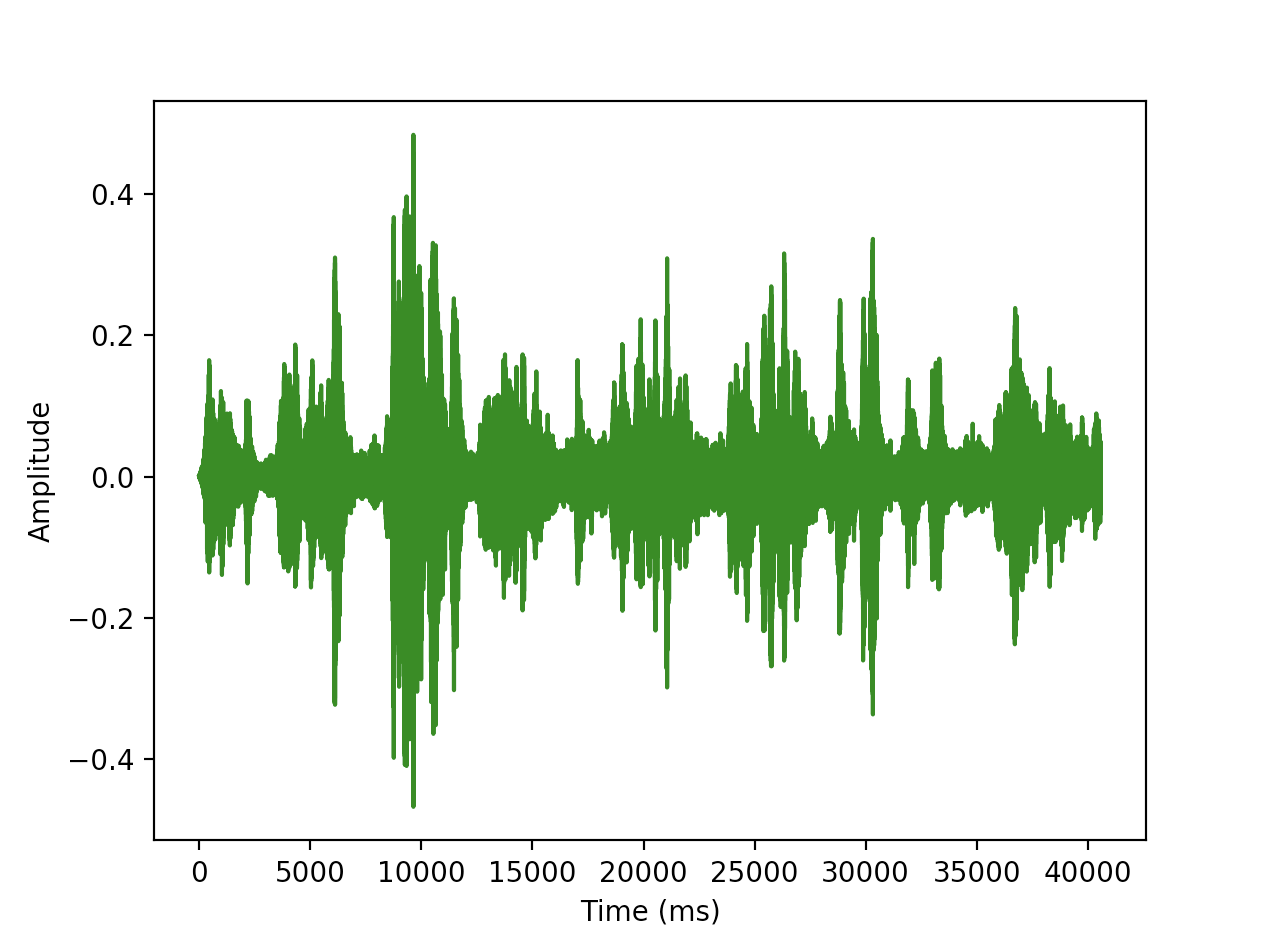

этот пост работал, несколько. После запуска я получил

однако этот график не содержать цвета, которые мне нужны. Мне нужна спектрограмма с цветами. Я попытался возиться с этим кодом, чтобы попытаться добавить цвета, однако, потратив значительное время и усилия на это, я не мог понять!

затем я попробовал этой учебник.

этот код разбился(в строке 17), когда я попытался запустить его с ошибкой TypeError: 'numpy.объект float64 ' нельзя интерпретировать как целое число.

строка 17:

samples = np.append(np.zeros(np.floor(frameSize/2.0)), sig)

Я пытался исправьте это, бросив

samples = int(np.append(np.zeros(np.floor(frameSize/2.0)), sig))

и я тоже пробовал

samples = np.append(np.zeros(int(np.floor(frameSize/2.0)), sig))

однако ни один из них не работал в конце.

Я бы очень хотел знать, как преобразовать мой .wav-файлы на спектрограммы с цветом, чтобы я мог их анализировать! Любая помощь будет оценена!!!!!

пожалуйста, скажите мне, если вы хотите, чтобы я предоставил дополнительную информацию о моей версии python, что я пытался, или чего я хочу достичь.

3 ответов

использовать scipy.signal.spectrogram.

import matplotlib.pyplot as plt

from scipy import signal

from scipy.io import wavfile

sample_rate, samples = wavfile.read('path-to-mono-audio-file.wav')

frequencies, times, spectrogram = signal.spectrogram(samples, sample_rate)

plt.pcolormesh(times, frequencies, spectrogram)

plt.imshow(spectrogram)

plt.ylabel('Frequency [Hz]')

plt.xlabel('Time [sec]')

plt.show()

Edit: putting plt.pcolormesh до plt.imshow кажется, исправить некоторые проблемы, как указано @Davidjb.

перед попыткой сделать это убедитесь, что ваш wav-файл является моно (одноканальным), а не стерео (двухканальным). Я настоятельно рекомендую прочитать документацию scipy на https://docs.scipy.org/doc/scipy-0.19.0/reference/generated/scipy.signal.spectrogram.html.

я исправила ошибки вы стоите на http://www.frank-zalkow.de/en/code-snippets/create-audio-spectrograms-with-python.html

Эта реализация лучше, потому что вы можете изменить binsize (например,binsize=2**8)

import numpy as np

from matplotlib import pyplot as plt

import scipy.io.wavfile as wav

from numpy.lib import stride_tricks

""" short time fourier transform of audio signal """

def stft(sig, frameSize, overlapFac=0.5, window=np.hanning):

win = window(frameSize)

hopSize = int(frameSize - np.floor(overlapFac * frameSize))

# zeros at beginning (thus center of 1st window should be for sample nr. 0)

samples = np.append(np.zeros(int(np.floor(frameSize/2.0))), sig)

# cols for windowing

cols = np.ceil( (len(samples) - frameSize) / float(hopSize)) + 1

# zeros at end (thus samples can be fully covered by frames)

samples = np.append(samples, np.zeros(frameSize))

frames = stride_tricks.as_strided(samples, shape=(int(cols), frameSize), strides=(samples.strides[0]*hopSize, samples.strides[0])).copy()

frames *= win

return np.fft.rfft(frames)

""" scale frequency axis logarithmically """

def logscale_spec(spec, sr=44100, factor=20.):

timebins, freqbins = np.shape(spec)

scale = np.linspace(0, 1, freqbins) ** factor

scale *= (freqbins-1)/max(scale)

scale = np.unique(np.round(scale))

# create spectrogram with new freq bins

newspec = np.complex128(np.zeros([timebins, len(scale)]))

for i in range(0, len(scale)):

if i == len(scale)-1:

newspec[:,i] = np.sum(spec[:,int(scale[i]):], axis=1)

else:

newspec[:,i] = np.sum(spec[:,int(scale[i]):int(scale[i+1])], axis=1)

# list center freq of bins

allfreqs = np.abs(np.fft.fftfreq(freqbins*2, 1./sr)[:freqbins+1])

freqs = []

for i in range(0, len(scale)):

if i == len(scale)-1:

freqs += [np.mean(allfreqs[int(scale[i]):])]

else:

freqs += [np.mean(allfreqs[int(scale[i]):int(scale[i+1])])]

return newspec, freqs

""" plot spectrogram"""

def plotstft(audiopath, binsize=2**10, plotpath=None, colormap="jet"):

samplerate, samples = wav.read(audiopath)

s = stft(samples, binsize)

sshow, freq = logscale_spec(s, factor=1.0, sr=samplerate)

ims = 20.*np.log10(np.abs(sshow)/10e-6) # amplitude to decibel

timebins, freqbins = np.shape(ims)

print("timebins: ", timebins)

print("freqbins: ", freqbins)

plt.figure(figsize=(15, 7.5))

plt.imshow(np.transpose(ims), origin="lower", aspect="auto", cmap=colormap, interpolation="none")

plt.colorbar()

plt.xlabel("time (s)")

plt.ylabel("frequency (hz)")

plt.xlim([0, timebins-1])

plt.ylim([0, freqbins])

xlocs = np.float32(np.linspace(0, timebins-1, 5))

plt.xticks(xlocs, ["%.02f" % l for l in ((xlocs*len(samples)/timebins)+(0.5*binsize))/samplerate])

ylocs = np.int16(np.round(np.linspace(0, freqbins-1, 10)))

plt.yticks(ylocs, ["%.02f" % freq[i] for i in ylocs])

if plotpath:

plt.savefig(plotpath, bbox_inches="tight")

else:

plt.show()

plt.clf()

return ims

ims = plotstft(filepath)

import os

import wave

import pylab

def graph_spectrogram(wav_file):

sound_info, frame_rate = get_wav_info(wav_file)

pylab.figure(num=None, figsize=(19, 12))

pylab.subplot(111)

pylab.title('spectrogram of %r' % wav_file)

pylab.specgram(sound_info, Fs=frame_rate)

pylab.savefig('spectrogram.png')

def get_wav_info(wav_file):

wav = wave.open(wav_file, 'r')

frames = wav.readframes(-1)

sound_info = pylab.fromstring(frames, 'int16')

frame_rate = wav.getframerate()

wav.close()

return sound_info, frame_rate

используйте graph_spectrogram (path_to_your_wav_file). Я не помню блог, откуда я взял этот фрагмент. Добавлю ссылку, когда увижу ее снова.