loss, val loss, acc и val acc не обновляются на протяжении всех эпох

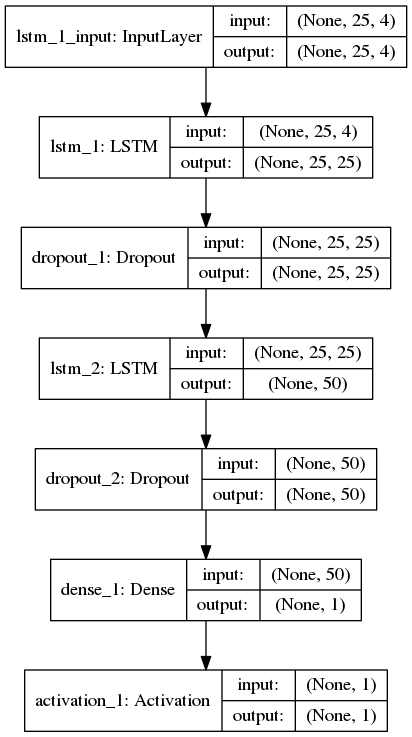

Я создал сеть LSTM для классификации последовательностей (двоичная), где каждый образец имеет 25 временных шагов и 4 функции. Ниже приведена топология сети keras:

выше, слой активации после плотного слоя использует функцию softmax. Я использовал binary_crossentropy для функции потерь и Adam в качестве оптимизатора для компиляции модели keras. Обученная модель с batch_size=256, shuffle=True и validation_split=0.05, следующая журнал тренировок:

Train on 618196 samples, validate on 32537 samples

2017-09-15 01:23:34.407434: I tensorflow/stream_executor/cuda/cuda_gpu_executor.cc:893] successful NUMA node read from SysFS had negative value (-1), but there must be at least one NUMA node, so returning NUMA node zero

2017-09-15 01:23:34.407719: I tensorflow/core/common_runtime/gpu/gpu_device.cc:955] Found device 0 with properties:

name: GeForce GTX 1050

major: 6 minor: 1 memoryClockRate (GHz) 1.493

pciBusID 0000:01:00.0

Total memory: 3.95GiB

Free memory: 3.47GiB

2017-09-15 01:23:34.407735: I tensorflow/core/common_runtime/gpu/gpu_device.cc:976] DMA: 0

2017-09-15 01:23:34.407757: I tensorflow/core/common_runtime/gpu/gpu_device.cc:986] 0: Y

2017-09-15 01:23:34.407764: I tensorflow/core/common_runtime/gpu/gpu_device.cc:1045] Creating TensorFlow device (/gpu:0) -> (device: 0, name: GeForce GTX 1050, pci bus id: 0000:01:00.0)

618196/618196 [==============================] - 139s - loss: 4.3489 - acc: 0.7302 - val_loss: 4.4316 - val_acc: 0.7251

Epoch 2/50

618196/618196 [==============================] - 132s - loss: 4.3489 - acc: 0.7302 - val_loss: 4.4316 - val_acc: 0.7251

Epoch 3/50

618196/618196 [==============================] - 134s - loss: 4.3489 - acc: 0.7302 - val_loss: 4.4316 - val_acc: 0.7251

Epoch 4/50

618196/618196 [==============================] - 133s - loss: 4.3489 - acc: 0.7302 - val_loss: 4.4316 - val_acc: 0.7251

Epoch 5/50

618196/618196 [==============================] - 132s - loss: 4.3489 - acc: 0.7302 - val_loss: 4.4316 - val_acc: 0.7251

Epoch 6/50

618196/618196 [==============================] - 132s - loss: 4.3489 - acc: 0.7302 - val_loss: 4.4316 - val_acc: 0.7251

Epoch 7/50

618196/618196 [==============================] - 132s - loss: 4.3489 - acc: 0.7302 - val_loss: 4.4316 - val_acc: 0.7251

Epoch 8/50

618196/618196 [==============================] - 132s - loss: 4.3489 - acc: 0.7302 - val_loss: 4.4316 - val_acc: 0.7251

... and so on through 50 epochs with same numbers

до сих пор я также пытался использовать оптимизаторы rmsprop, nadam и batch_size(s) 128, 512, 1024, но потеря, val_loss, acc, val_acc всегда оставалась одинаковой во все эпохи, давая точность в диапазоне от 0,72 до 0,74 в каждой моей попытке.

1 ответов

на softmax активация гарантирует, что сумма выходов равна 1. Это полезно для обеспечения того, что только один класс среди многих классов будет выход.

поскольку у вас есть только 1 выход (только один класс), это конечно плохая идея. Вы, вероятно, в конечном итоге с 1 в результате для всех образцов.

использовать sigmoid вместо. Это хорошо сочетается с binary_crossentropy.