Unpivot в spark-sql/pyspark

У меня есть проблема, в которой я хочу распаковать таблицу в spark-sql/pyspark. Я просмотрел документацию, и я видел, что есть поддержка только для pivot, но пока нет поддержки un-pivot. Есть ли способ достичь этого?

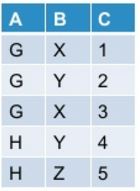

Пусть моя начальная таблица выглядит так:

когда я поворачиваю это в pyspark, используя следующую команду:

df.groupBy("A").pivot("B").sum("C")

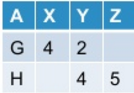

Я получаю это как вывод:

теперь я хочу отключить поворотную таблицу. В общем, эта операция может / не может дать исходную таблицу на основе того, как я развернул исходную таблицу.

Spark-sql на данный момент не предоставляет из коробки поддержку unpivot. Есть ли способ достичь этого?

1 ответов

Вы можете использовать встроенную функцию стека, например в Scala:

scala> val df = Seq(("G",Some(4),2,None),("H",None,4,Some(5))).toDF("A","X","Y", "Z")

df: org.apache.spark.sql.DataFrame = [A: string, X: int ... 2 more fields]

scala> df.show

+---+----+---+----+

| A| X| Y| Z|

+---+----+---+----+

| G| 4| 2|null|

| H|null| 4| 5|

+---+----+---+----+

scala> df.select($"A", expr("stack(3, 'X', X, 'Y', Y, 'Z', Z) as (B, C)")).where("C is not null").show

+---+---+---+

| A| B| C|

+---+---+---+

| G| X| 4|

| G| Y| 2|

| H| Y| 4|

| H| Z| 5|

+---+---+---+

или в pyspark:

In [1]: df = spark.createDataFrame([("G",4,2,None),("H",None,4,5)],list("AXYZ"))

In [2]: df.show()

+---+----+---+----+

| A| X| Y| Z|

+---+----+---+----+

| G| 4| 2|null|

| H|null| 4| 5|

+---+----+---+----+

In [3]: df.selectExpr("A", "stack(3, 'X', X, 'Y', Y, 'Z', Z) as (B, C)").where("C is not null").show()

+---+---+---+

| A| B| C|

+---+---+---+

| G| X| 4|

| G| Y| 2|

| H| Y| 4|

| H| Z| 5|

+---+---+---+