Как запустить Spark code в воздушном потоке?

Привет, люди Земли!

Я использую Airflow для планирования и запуска задач Spark.

Все, что я нашел к этому времени, - это python DAGs, которым может управлять воздушный поток.

пример DAG:

spark_count_lines.py

import logging

from airflow import DAG

from airflow.operators import PythonOperator

from datetime import datetime

args = {

'owner': 'airflow'

, 'start_date': datetime(2016, 4, 17)

, 'provide_context': True

}

dag = DAG(

'spark_count_lines'

, start_date = datetime(2016, 4, 17)

, schedule_interval = '@hourly'

, default_args = args

)

def run_spark(**kwargs):

import pyspark

sc = pyspark.SparkContext()

df = sc.textFile('file:///opt/spark/current/examples/src/main/resources/people.txt')

logging.info('Number of lines in people.txt = {0}'.format(df.count()))

sc.stop()

t_main = PythonOperator(

task_id = 'call_spark'

, dag = dag

, python_callable = run_spark

)

проблема в том, что я не хорош в коде Python и имею некоторые задачи, написанные на Java. Мой вопрос в том, как запустить Spark Java jar в python DAG? Или, может быть, есть другой способ сделать это? Я нашел искру submit:http://spark.apache.org/docs/latest/submitting-applications.html

Но Я не знаю, как соединить все вместе. Может быть, кто-то использовал его раньше и имеет рабочий пример. Спасибо, что уделили мне время!

3 ответов

вы должны иметь возможность использовать BashOperator. Сохраняя остальную часть кода как есть, импортируйте необходимый класс и системные пакеты:

from airflow.operators.bash_operator import BashOperator

import os

import sys

установить необходимые пути:

os.environ['SPARK_HOME'] = '/path/to/spark/root'

sys.path.append(os.path.join(os.environ['SPARK_HOME'], 'bin'))

и добавить оператор:

spark_task = BashOperator(

task_id='spark_java',

bash_command='spark-submit --class {{ params.class }} {{ params.jar }}',

params={'class': 'MainClassName', 'jar': '/path/to/your.jar'},

dag=dag

)

вы можете легко расширить это, чтобы предоставить дополнительные аргументы с помощью шаблонов Jinja.

вы можете, конечно, настроить это для сценария без искры, заменив bash_command с шаблоном соответствующим в вашем случае, для пример:

bash_command = 'java -jar {{ params.jar }}'

и настройка params.

воздушный поток от версии 1.8 (выпущенной сегодня), имеет

- SparkSqlOperator - https://github.com/apache/incubator-airflow/blob/master/airflow/contrib/operators/spark_sql_operator.py;

код SparkSQLHook - https://github.com/apache/incubator-airflow/blob/master/airflow/contrib/hooks/spark_sql_hook.py

- SparkSubmitOperator - https://github.com/apache/incubator-airflow/blob/master/airflow/contrib/operators/spark_submit_operator.py

код SparkSubmitHook - https://github.com/apache/incubator-airflow/blob/master/airflow/contrib/hooks/spark_submit_hook.py

обратите внимание, что эти два новых оператора/крючка Spark находятся в ветви "contrib" с версии 1.8, поэтому (хорошо) не документированы.

таким образом, Вы можете использовать SparkSubmitOperator для отправки кода java для выполнения Spark.

пример SparkSubmitOperator использование для Spark 2.3.1 на kubernetes (экземпляр minikube):

Code that goes along with the Airflow located at:

http://airflow.readthedocs.org/en/latest/tutorial.html

"""

from airflow import DAG

from airflow.operators.bash_operator import BashOperator

from airflow.contrib.operators.spark_submit_operator import SparkSubmitOperator

from airflow.models import Variable

from datetime import datetime, timedelta

default_args = {

'owner': 'user@mail.com',

'depends_on_past': False,

'start_date': datetime(2018, 7, 27),

'email': ['user@mail.com'],

'email_on_failure': False,

'email_on_retry': False,

'retries': 1,

'retry_delay': timedelta(minutes=5),

# 'queue': 'bash_queue',

# 'pool': 'backfill',

# 'priority_weight': 10,

'end_date': datetime(2018, 7, 29),

}

dag = DAG(

'tutorial_spark_operator', default_args=default_args, schedule_interval=timedelta(1))

t1 = BashOperator(

task_id='print_date',

bash_command='date',

dag=dag)

print_path_env_task = BashOperator(

task_id='print_path_env',

bash_command='echo $PATH',

dag=dag)

spark_submit_task = SparkSubmitOperator(

task_id='spark_submit_job',

conn_id='spark_default',

java_class='com.ibm.cdopoc.DataLoaderDB2COS',

application='local:///opt/spark/examples/jars/cppmpoc-dl-0.1.jar',

total_executor_cores='1',

executor_cores='1',

executor_memory='2g',

num_executors='2',

name='airflowspark-DataLoaderDB2COS',

verbose=True,

driver_memory='1g',

conf={

'spark.DB_URL': 'jdbc:db2://dashdb-dal13.services.dal.bluemix.net:50001/BLUDB:sslConnection=true;',

'spark.DB_USER': Variable.get("CEDP_DB2_WoC_User"),

'spark.DB_PASSWORD': Variable.get("CEDP_DB2_WoC_Password"),

'spark.DB_DRIVER': 'com.ibm.db2.jcc.DB2Driver',

'spark.DB_TABLE': 'MKT_ATBTN.MERGE_STREAM_2000_REST_API',

'spark.COS_API_KEY': Variable.get("COS_API_KEY"),

'spark.COS_SERVICE_ID': Variable.get("COS_SERVICE_ID"),

'spark.COS_ENDPOINT': 's3-api.us-geo.objectstorage.softlayer.net',

'spark.COS_BUCKET': 'data-ingestion-poc',

'spark.COS_OUTPUT_FILENAME': 'cedp-dummy-table-cos2',

'spark.kubernetes.container.image': 'ctipka/spark:spark-docker',

'spark.kubernetes.authenticate.driver.serviceAccountName': 'spark'

},

dag=dag,

)

t1.set_upstream(print_path_env_task)

spark_submit_task.set_upstream(t1)

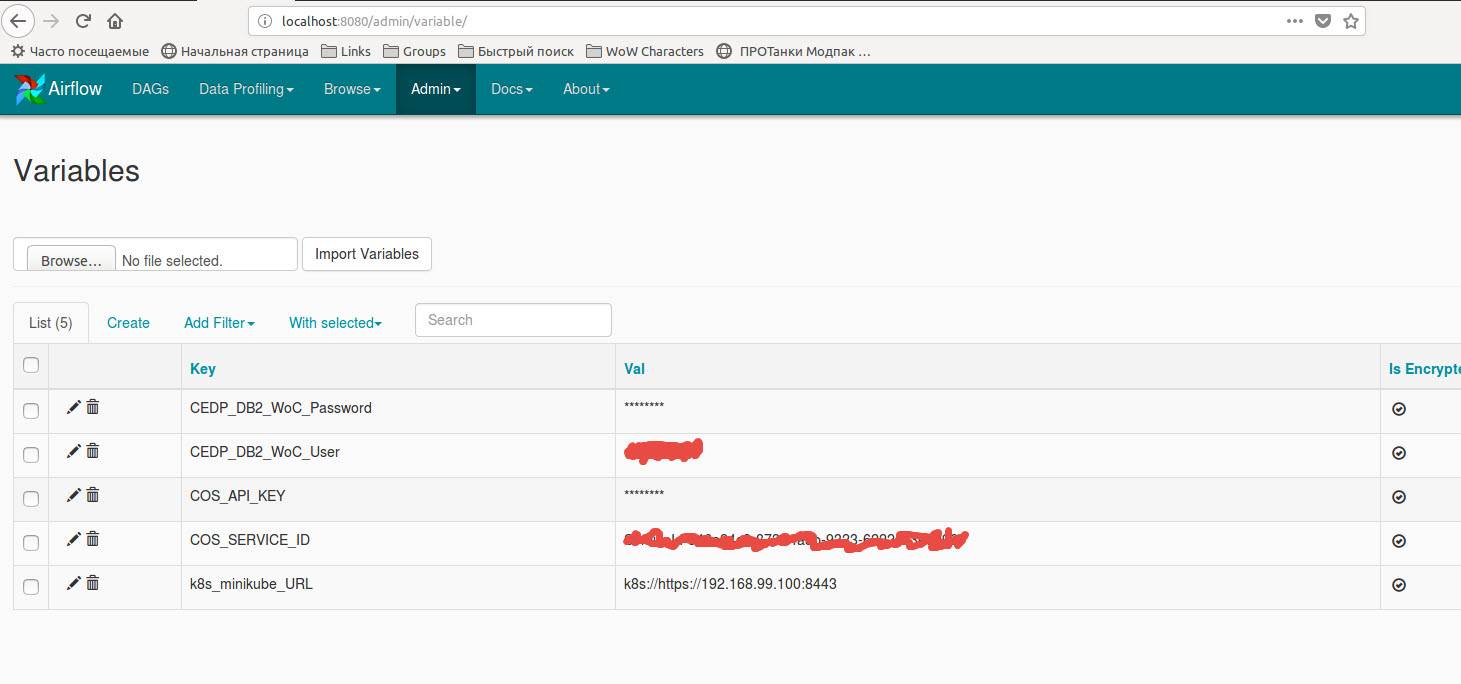

код с использованием переменных, хранящихся в переменных воздушного потока:

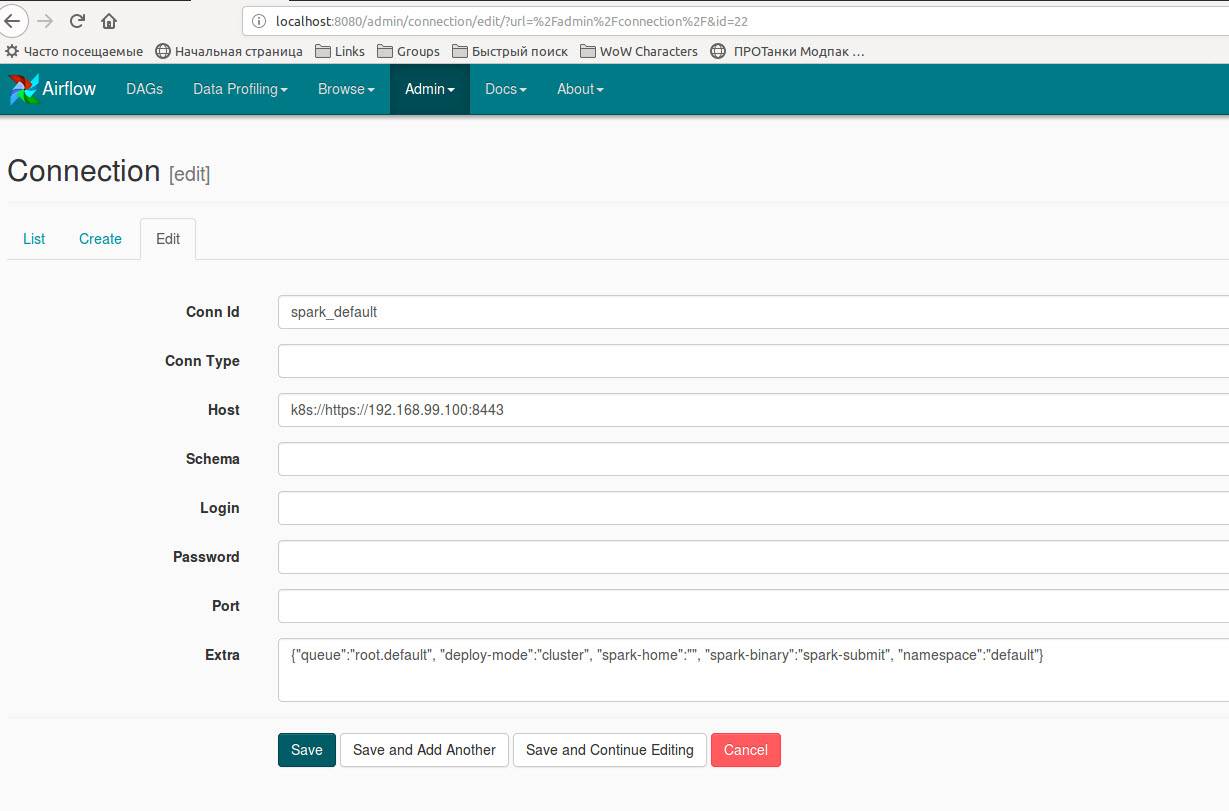

кроме того, вам нужно создать новое соединение spark или отредактировать существующий 'spark_default' с помощью

дополнительный словарь {"queue":"root.default", "deploy-mode":"cluster", "spark-home":"", "spark-binary":"spark-submit", "namespace":"default"}: